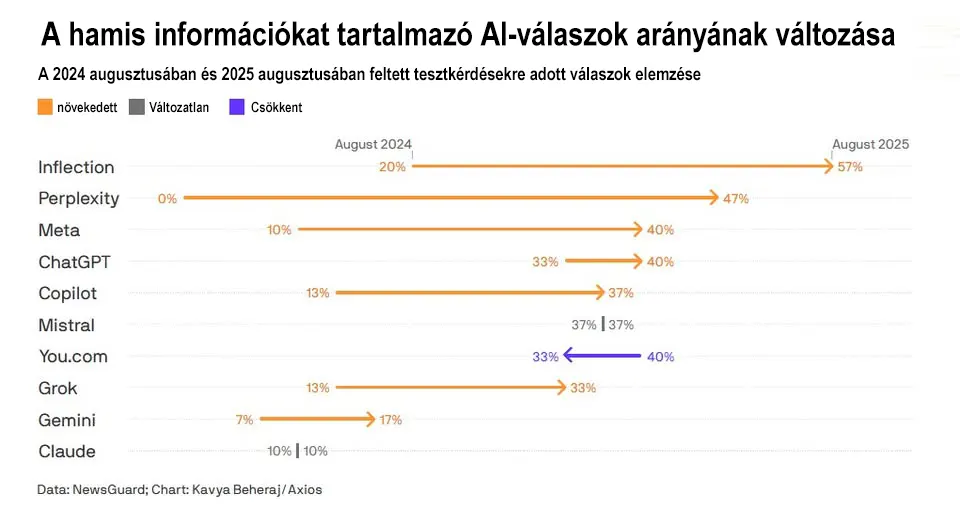

Az OpenAI-nál azon dolgoznak, hogy az AI rendszerek egyre használhatóbbak és megbízhatóbbak legyenek. Ezért jelentettek meg a közelmúltban egy cikket arról, hogy miért is „hallucinálnak” a nyelvi modellek? Még ha a nyelvi modellek (language models) egyre fejlettebbek is, van egy kihívás, amit nehéz teljesen kiküszöbölni: a hallucináció. Itt olyan esetekről van szó, amikor egy modell magabiztosan állít valamit, ami nem igaz.

Például: amikor egy cikk szerzője doktori dolgozatának címét kérdezték, a modell három különböző választ adott — mindegyik helytelen volt. Mint ahogy az is, amikor a születésnapját kérdezték. Újra három hibás dátumot kaptak.

Mi az a hallucináció?

Hallucináció alatt olyan, látszólag lehetséges, de valójában hamis állításokat értünk, amelyeket a nyelvi modell hoz létre. Ezek akár meglepő formában is felbukkanhatnak, még látszólag egyszerű kérdéseknél is.

Miért tartják fenn a nyelvi modellek a hallucinációk jelenségét?

Az egyik oka az, hogy a jelenlegi értékelési (evaluációs) módszerek helytelen ösztönzőket alakítanak ki. Ezek az értékelések gyakran azt jutalmazzák, ha a modell tippel, még akkor is, ha nem biztos a válaszban, ahelyett hogy bevallanák: „nem tudom”.

Például gondoljunk egy feleletválasztós tesztre: ha nem tudod a választ, tippelhetsz, és néha igazad lehet – de ha nem tippelsz, biztosan nulla pontot kapsz. Ugyanígy, ha a modell csak akkor válaszol, ha biztos valamiben, gyakran jobb lenne „nem tudom”-mal reagálni, de ez a módszer rosszabb pontszámot eredményez, ha az értékelés csak a helyes válaszokat díjazza.

Hogyan lehetne jobban értékelni?

A OpenAI cikke szerint a nyelvi modellek értékelési módszerein kellene változtatni.

- Magabiztos hibák (amikor a modell rosszul válaszol, de magabiztos) nagyobb büntetést kapjanak.

- Bizonytalanság kifejezése (amikor a modell bevallja, hogy nem tudja a választ) részpontokat kapjon.

- Az ellenőrzéseknél (benchmarks) ne csak az legyen a cél, hogy mennyi a pontosság, hanem az is számítson, hogy mennyire megbízható, mennyire tisztában a modell a saját bizonytalanságaival.

Hogyan keletkeznek a hallucinációk (a „next-word prediction” logikája)

Hogyan keletkeznek a hallucinációk (a „next-word prediction” logikája)

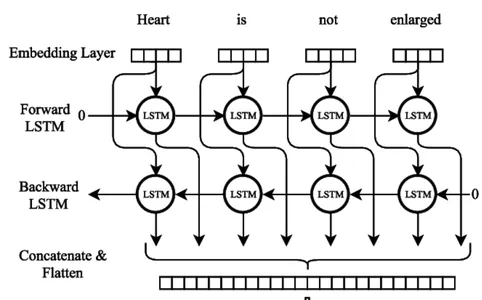

A nagy nyelvi modellek először egy nagy mennyiségű szövegen tanulnak úgy, hogy megpróbálja megjósolni, mi lesz a következő szó. Ez a tanulási mód azonban nem tartalmaz „igaz/hamis” címkéket arra vonatkozóan, hogy egy adott állítás helyes‐e vagy sem. A modell csak azt látja, hogy milyen kombinációk fordulnak elő gyakran a szövegben, és ezek alapján alakít ki valószínűségeket.

Ez két probléma miatt vezethet hallucinációhoz:

- Ritka tények: Olyan információk, amelyek nagyon ritkán fordulnak elő, nem tanulhatók meg megbízhatóan pusztán gyakoriság alapján.

- Minta felismerése, de nem jelentés igazolása: A modell megtanulja, hogy milyen szókapcsolatok és szerkezetek fordulnak elő gyakran; viszont azt, hogy egy adott tény igaz-e, nem mindig ellenőrzi.

Tanulságok

Tanulságok

- 100% pontosság soha nem lesz elérhető, mert vannak olyan kérdések, amelyekre nincs járható válasz (pl. ha az információ nem áll rendelkezésre, vagy ha alapvetően bizonytalan).

- Hallucinációk nem elkerülhetetlenek — egy modell absztinenciával (amikor bizonytalan, nem ad választ) tud csökkenteni ezen.

- Nem csak a nagy modellek lehetnek jobbak ebben — egy kisebb modell, amely felismeri, hogy nem tud valamit, gyakran jól járhat; nem kell mindig nagy számítási kapacitás a bizonytalanság kezelése tekintetében.

- Fontos, hogy megértsük, statikus mechanizmusok (mint a következő szó előrejelzése és az értékelési rendszerek) miként járulnak hozzá a problémához. Nem hibáról vagy misztikus jelenségről van szó, hanem következményről abból, ahogy a modellek tanulnak és mérnek.

Hogyan használhatják tanárok az órán?

Néhány ötlet:

- Definíciók és példák: mutass be definíciókat (pl. mi az a hallucináció), és illusztrálj konkrét példákkal (a cikkből vagy más forrásból) hogy tanulók lássák, mit jelent.

- Viták / kérdések:

- Mikor baj, ha egy AI „csak tippel”?

- Milyen értékelési rendszerek léteznek az iskolában, amelyek hasonlítanak erre?

- Hogyan lehetne a házi feladatokat, teszteket úgy alakítani, hogy ne ösztönözzenek „tippelést”, hanem az őszinteséget a bizonytalansággal kapcsolatban?

- Gyakorlati feladatok: kérj meg a diákokat, hogy írjanak le példákat AI hallucinációra (pl. hírek, internetes források alapján), majd analizálják, mi vezetett ahhoz, hogy a modell hibázzon.

- Összehasonlítások: bemutatni két modellt, egy kisebbet és egy nagyobbat, és megnézni, melyik mennyire vállalja a bizonytalanságot.

Discover more from Magyar Iskola

Subscribe to get the latest posts sent to your email.